苏斯博士的散文揭示了大脑是如何处理语言的

罗彻斯特大学德尔蒙特神经科学研究所的研究人员已经扩展了对大脑在复杂视听语言感知过程中是如何参与的理解。

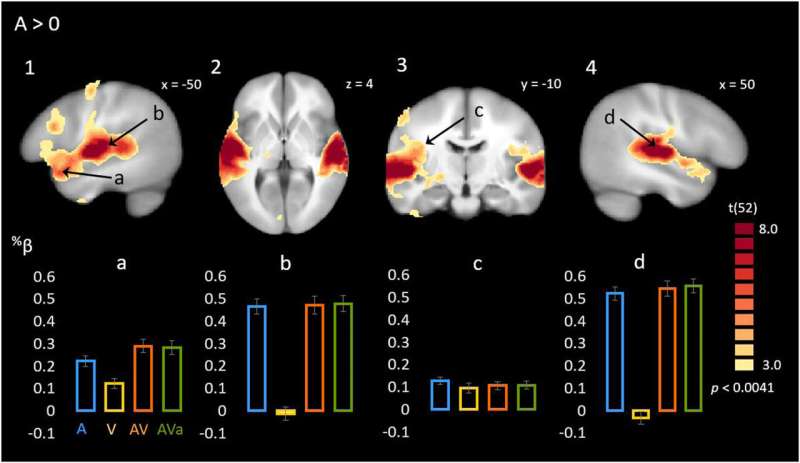

这项研究现在发表在科学杂志,描述了听和看讲述者讲故事是如何激活大脑中相关区域的广泛网络的感觉处理,多种感觉的集成以及与理解故事内容相关的认知功能。了解这个更大的网络的参与有可能给研究人员提供研究神经发育障碍的新方法。

影像科学和神经科学研究助理教授、该研究的第一作者Lars Ross博士说:“多感官整合是我们神经系统的一项重要功能,因为它可以大大增强我们检测和识别环境中物体的能力。”“这种功能的失效可能会导致感觉环境被认为是压倒性的,并可能导致一个人难以适应周围环境,我们认为这是一些神经发育障碍,如自闭症的潜在症状。”

研究人员使用功能磁共振成像技术(fMRI)检测了53名参与者在观看讲话者朗读《洛拉克斯》(the Lorax)的视频时的大脑活动。故事的呈现方式会以四种方式中的一种随机变化——纯音频、纯视频、同步视听或不同步视听。

研究人员还监测了参与者的眼球运动。他们发现,除了之前识别的多感官整合区域,观察说话者的面部动作也得到了增强大脑的活动在更广泛的语义网络和通常不与多感觉整合相关的语言外区域,如杏仁核和初级视觉皮层。研究人员还发现丘脑大脑区域的活动,这是非常早期的阶段感觉信息我们的眼睛和耳朵相互作用。

“这暗示了许多其他地区多种感觉的集成在大脑处理复杂的多感官语言——包括与语言外感知和认知处理相关的语言——的过程中起着重要作用,”罗斯说。

研究人员在设计这个实验时考虑到了儿童,据已经开始在儿童和成人身上进行研究的研究人员说自闭症为了深入了解他们处理视听语言的能力是如何随着时间的推移而发展的。

“我们的实验室对这个网络非常感兴趣,因为它在一些神经发育障碍中出错,”该研究的主要作者John Foxe博士说。“现在我们已经设计了这个多感官语音整合网络的详细地图,我们可以问更多关于多感官语音的尖锐问题神经发育障碍比如自闭症和阅读障碍,然后具体分析大脑电路可能会受到影响。”

进一步探索